2024年6月3日,英偉達公司發布了其最新的高性能顯卡——H200,這款顯卡旨在為人工智能(AI)和高性能計算(HPC)領域帶來革命性的性能提升。作為英偉達最新一代的Tensor核心GPU,H200顯卡集成了多項先進技術,專為處理最復雜的計算任務而設計。本文將詳細介紹H200顯卡的核心技術與規格,揭示其在各大應用場景中的巨大潛力。

新一代架構:Hopper

第四代Tensor核心

英偉達 H200 顯卡基于最新的Hopper架構,這一架構引入了第四代Tensor核心技術,顯著提高了處理AI和HPC任務的效率。新的Tensor核心能夠更好地處理復雜的深度學習模型和高性能計算任務,尤其是在處理大規模數據集時表現卓越。

顯卡參數

核心規格

GPU內核數量: 18000個CUDA核心

Tensor核心數量: 576個第四代Tensor核心

RT核心數量: 144個第三代RT核心,用于光線追蹤加速

內存與帶寬

顯存容量: 141GB HBM3e

內存帶寬: 4.8TB/s,提供了比前代顯卡更高的內存容量和速度,能夠支持大規模數據處理和復雜計算任務。

先進的計算能力

多精度支持

H200顯卡支持多種計算精度,包括FP64、FP32、TF32、BFLOAT16、FP16、FP8和INT8。這種靈活性允許用戶根據具體的計算需求選擇最佳的精度,優化計算效率和資源利用。

散熱與能效

優化的散熱設計

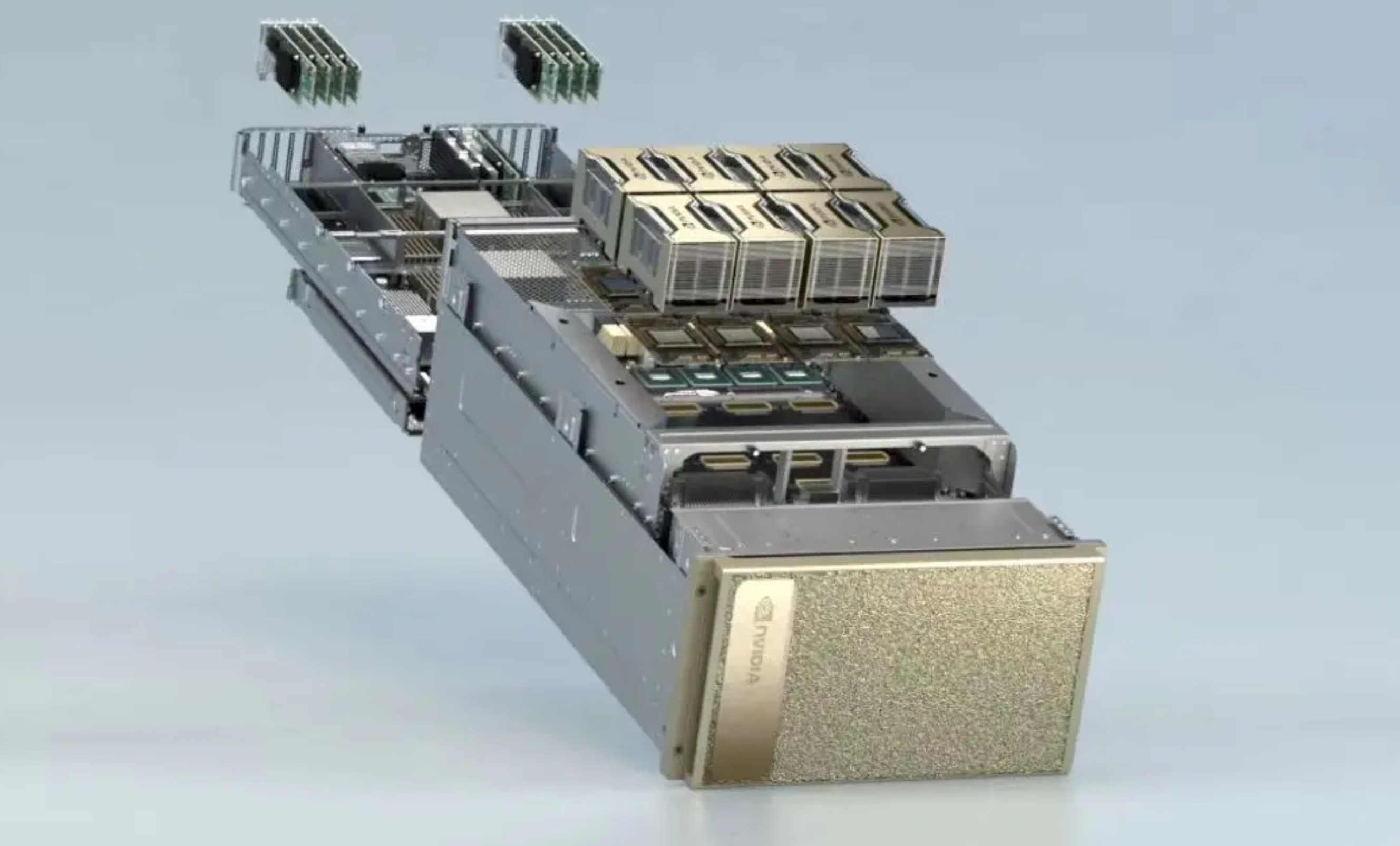

為了應對高性能計算帶來的巨大熱量,H200顯卡采用了全新的散熱設計,結合了空氣冷卻和液冷系統。新設計不僅提高了散熱效率,還確保了顯卡在高負載下的穩定運行。

能效比提升

H200顯卡在提高性能的同時,也注重能效比的提升。新架構和先進的制造工藝使得H200在高性能計算中能夠保持更低的功耗,降低了數據中心的運營成本。

互聯技術與擴展性

NVLink和PCIe 5.0

H200顯卡支持NVIDIA NVLink和PCIe 5.0接口,提供更高的帶寬和更快的數據傳輸速度。NVLink能夠將多達8個H200顯卡連接在一起,形成一個強大的計算集群,滿足超大規模計算任務的需求。

多GPU擴展

得益于NVLink技術,H200顯卡可以實現多GPU的無縫擴展,增強了系統的靈活性和擴展性,使其在大規模AI訓練和高性能計算環境中表現尤為出色。

應用場景

人工智能與深度學習

H200顯卡專為大規模深度學習訓練和推理任務而設計,其強大的計算能力和高帶寬內存使其在訓練大型語言模型(如GPT-4)時表現卓越。

科學計算與模擬

在科學計算和模擬領域,H200顯卡憑借其強大的計算能力和高效的散熱系統,為氣候模型、物理仿真和其他復雜計算提供了理想的解決方案。

數據中心與云計算

H200顯卡在數據中心和云計算環境中具有顯著優勢。其高性能和低功耗特點使其成為構建高效能計算集群和提供AI即服務(AIaaS)的理想選擇。

英偉達H200顯卡的發布標志著高性能計算和人工智能應用的又一次重大飛躍。其先進的Hopper架構、強大的計算能力、優化的散熱設計和卓越的能效比,使其在各大應用場景中展現出無與倫比的優勢。隨著英偉達H200顯卡的廣泛應用,我們期待看到其在推動技術進步和業務創新方面的巨大潛力。

總之,英偉達H200顯卡不僅為當前的高性能計算和人工智能應用提供了強大的支持,還為未來的科技發展奠定了堅實的基礎。