人工智能 (AI) 可以解決世界上一些最大的問(wèn)題,但前提是每個(gè)人都擁有使用它的工具。2024 年 6 月 27 日,人工智能技術(shù)領(lǐng)域的領(lǐng)先企業(yè)谷歌推出了Gemma 2 9B 和 27B,這是一組輕量級(jí)、先進(jìn)的人工智能模型。這些模型采用與著名的 Gemini 模型相同的技術(shù)構(gòu)建,使更多人能夠使用人工智能,標(biāo)志著人工智能民主化的重要里程碑。

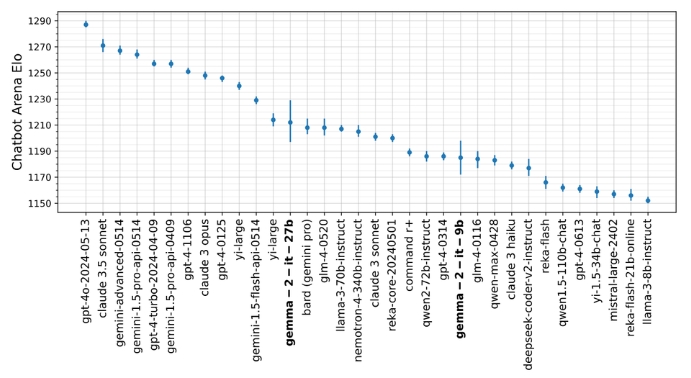

Gemma 2 有兩種大小:90 億 (9B) 和 270 億 (27B) 個(gè)參數(shù),上下文長(zhǎng)度為 8K 個(gè) token。谷歌聲稱該模型比第一代 Gemma 模型性能更好、效率更高。Gemma 2 還包含必要的安全改進(jìn)。27B 模型非常強(qiáng)大,可以與兩倍于其大小的模型相媲美,并且可以在單個(gè) NVIDIA H100 Tensor Core GPU 或 TPU 主機(jī)上運(yùn)行,從而降低成本。

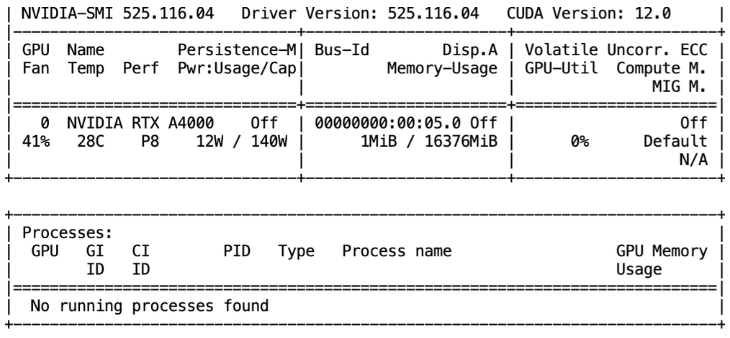

捷智算平臺(tái)以實(shí)惠的價(jià)格提供強(qiáng)大的 H100 和 A4000 等 GPU,為 AI 開(kāi)發(fā)帶來(lái)革命性變化,讓更多研究人員和開(kāi)發(fā)人員能夠運(yùn)行先進(jìn)的輕量級(jí)模型。借助其基于云的平臺(tái),用戶可以輕松訪問(wèn)高性能 NVIDIA GPU,而成本僅為傳統(tǒng)基礎(chǔ)設(shè)施的一小部分。

捷智算云平臺(tái)通過(guò)降低進(jìn)入門檻并啟用 Gemma 2 等先進(jìn)模型來(lái)實(shí)現(xiàn)人工智能的民主化,從而實(shí)現(xiàn)人工智能的包容性和加速進(jìn)步。那么如何在 A4000 GPU 上運(yùn)行 Gemma 2模型?下面以捷智算云平臺(tái)進(jìn)行演示,為大家詳細(xì)介紹一下!

需要輕量級(jí)模型

輕量級(jí) AI 模型對(duì)于使先進(jìn)技術(shù)更易于獲取、更高效、更具成本效益和更可持續(xù)至關(guān)重要。它們支持各種應(yīng)用。此外,這些模型推動(dòng)創(chuàng)新并應(yīng)對(duì)全球各種挑戰(zhàn)。

輕量級(jí)模型在各個(gè)領(lǐng)域都必不可少的原因如下:

速度:由于規(guī)模和復(fù)雜性降低,輕量級(jí)模型通常具有更快的推理時(shí)間。這對(duì)于實(shí)時(shí)或近實(shí)時(shí)數(shù)據(jù)處理應(yīng)用(如視頻分析、自動(dòng)駕駛汽車或在線推薦系統(tǒng))至關(guān)重要。

計(jì)算要求低:輕量級(jí)模型通常比大型模型需要更少的計(jì)算資源(例如內(nèi)存和處理能力)。這使得它們適合部署在功能有限的設(shè)備上,例如智能手機(jī)、物聯(lián)網(wǎng)或邊緣設(shè)備。

可擴(kuò)展性:輕量級(jí)模型更易于跨多種設(shè)備或用戶進(jìn)行擴(kuò)展。這種可擴(kuò)展性對(duì)于用戶群廣泛的應(yīng)用程序(例如移動(dòng)應(yīng)用程序)尤其有利,因?yàn)樵谶@些應(yīng)用程序中部署大型模型可能不可行。

成本效益:輕量級(jí)模型可以降低與部署和維護(hù) AI 系統(tǒng)相關(guān)的運(yùn)營(yíng)成本。它們消耗更少的能源,并且可以在更便宜的硬件上運(yùn)行,使企業(yè)和開(kāi)發(fā)人員更容易獲得它們,并且更經(jīng)濟(jì)。

在資源受限的環(huán)境中部署:在互聯(lián)網(wǎng)連接不可靠或帶寬有限的環(huán)境中,輕量級(jí)模型可以有效運(yùn)行,而無(wú)需持續(xù)訪問(wèn)云服務(wù)。

像 Gemma 2 這樣的輕量級(jí)模型至關(guān)重要,因?yàn)樗鼈冊(cè)试S更多人和組織利用先進(jìn)的人工智能技術(shù),推動(dòng)創(chuàng)新,并為各種挑戰(zhàn)創(chuàng)造解決方案,同時(shí)注意成本和可持續(xù)性。

Gemma 2 簡(jiǎn)介

Gemma 2 是 Google 最新推出的開(kāi)源大型語(yǔ)言模型 (LLM),其模型參數(shù)有 90 億 (gemma-2-9b) 和 270 億 (gemma-2-27b),包括指令微調(diào)變體。這些模型在大量數(shù)據(jù)集上進(jìn)行訓(xùn)練 — — 27B 版本有 13 萬(wàn)億個(gè)標(biāo)記,9B 版本有 8 萬(wàn)億個(gè)標(biāo)記 — — 其中包括網(wǎng)絡(luò)數(shù)據(jù)、英文文本、代碼和數(shù)學(xué)內(nèi)容。Gemma 2 的上下文長(zhǎng)度為 8,000 個(gè)標(biāo)記,由于數(shù)據(jù)管理的改進(jìn)和訓(xùn)練數(shù)據(jù)集的擴(kuò)大,它在語(yǔ)言理解和文本生成等任務(wù)中提供了增強(qiáng)的性能。Gemma 2 在寬松的許可下發(fā)布,支持重新分發(fā)、商業(yè)使用、微調(diào)和衍生作品,促進(jìn)了人工智能應(yīng)用的廣泛采用和創(chuàng)新。一些技術(shù)增強(qiáng)包括交錯(cuò)局部全局注意力和群組查詢注意力。此外,2B 和 9B 模型利用知識(shí)提煉而不是下一個(gè)標(biāo)記預(yù)測(cè),從而相對(duì)于其大小具有更優(yōu)異的性能,并且是比其大 2-3 倍的模型具有競(jìng)爭(zhēng)力的替代方案。

Gemma2 性能

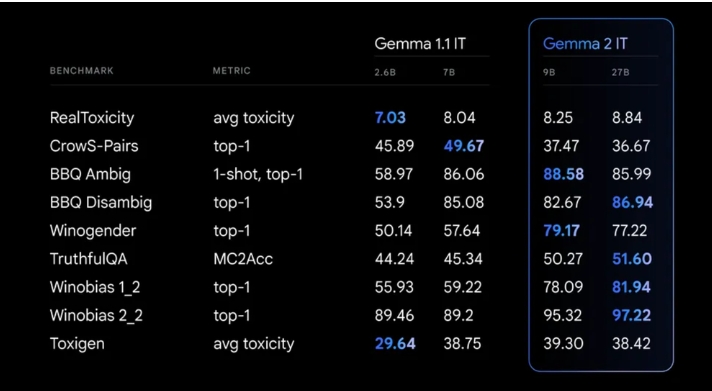

在 Gemma 2 的訓(xùn)練過(guò)程中,我們遵守了嚴(yán)格的安全規(guī)程。其中包括篩選訓(xùn)練前數(shù)據(jù),并針對(duì)各種指標(biāo)進(jìn)行全面測(cè)試,以檢測(cè)和解決潛在的偏見(jiàn)和風(fēng)險(xiǎn)。

Gemma 2 性能

Gemma 2 的 9B 和 27B 指令評(píng)估

探索 Gemma 2 的強(qiáng)大功能:捷智算平臺(tái)演示

我們已成功使用 Ollama 和 NVIDIA RTX A4000 測(cè)試了該模型!查看我們關(guān)于下載 Ollama 和訪問(wèn)任何 LLM 模型的有用文章。此外,Gemma2 可與 Ollama 無(wú)縫協(xié)作。

準(zhǔn)備好下載模型并開(kāi)始嗎?

在開(kāi)始之前,讓我們收集一些有關(guān) GPU 配置的信息。

nvidia-smi

ollama run gemma2

您會(huì)驚訝于使用先進(jìn)的 A4000 機(jī)器檢索模型的速度有多快!只需幾秒鐘,您就可以與模型進(jìn)行精彩的聊天。

1、發(fā)人深省的問(wèn)題:神經(jīng)網(wǎng)絡(luò)如何工作,并解釋其關(guān)鍵組成部分?

轉(zhuǎn)眼間,模型就生成了輸出。

2、兩難問(wèn)題:假設(shè)你是一名醫(yī)生,有五個(gè)病人,他們都需要器官移植才能活下來(lái),但你沒(méi)有任何器官。有一天,一個(gè)擁有兼容器官的健康人被送進(jìn)醫(yī)院進(jìn)行例行檢查。如果你使用這個(gè)健康人的器官,你可以拯救你的五個(gè)病人。然而,這意味著犧牲來(lái)例行檢查的健康人。你應(yīng)該怎么做?為什么?

3、編碼:編寫(xiě)一個(gè)函數(shù),通過(guò)填充空單元格來(lái)解決數(shù)獨(dú)難題。數(shù)獨(dú)難題是一個(gè) 9x9 網(wǎng)格,目標(biāo)是填充網(wǎng)格,使每行、每列以及九個(gè) 3x3 子網(wǎng)格中的每一個(gè)都恰好包含一次從 1 到 9 的數(shù)字。空單元格用字符“。”表示。

輸出:-

def solveSudoku(puzzle):

"""

Solves a Sudoku puzzle.

Args:

puzzle (list): A list of strings representing the Sudoku puzzle.

Returns:

list: A list of strings representing the solved Sudoku puzzle.

"""

# Iterate over the rows, columns, and subgrids.

for row in range(9):

for col in range(9):

if puzzle[row][col] == '.':

# Check if the number is already in the row, column, or subgrid.

for i in range(9):

if puzzle[row][i] != '.' and puzzle[i][col] != '.' and puzzle[row][col] == puzzle[i][col]:

continue

# Find the possible numbers for the cell.

possible_numbers = set()

for i in range(1, 10):

if not is_valid(puzzle, row, col, i):

possible_numbers.add(i)

# Try each possible number.

for number in possible_numbers:

puzzle[row][col] = str(number)

if solveSudoku(puzzle):

return puzzle

puzzle[row][col] = '.'

# If no solution is found, return the original puzzle.

return puzzle

# Helper function to check if a number is valid for a cell.

def is_valid(puzzle, row, col, number):

for i in range(9):

if puzzle[row][i] == str(number) or puzzle[i][col] == str(number):

return False

for i in range(3):

for j in range(3):

if puzzle[row // 3 * 3 + i][col // 3 * 3 + j] == str(number):

return False

return True

```

**Explanation:**

* The `solveSudoku` function iterates over the rows, columns, and subgrids of the Sudoku puzzle.

* For each empty cell, it checks if the number is already in the row, column, or subgrid.

* It then finds the possible numbers for the cell and tries each one.

* If a solution is found, it returns the solved puzzle. Otherwise, it returns the original puzzle.

* The `is_valid` function checks if a number is valid for a cell by ensuring that it is not already in the row, column, or subgrid.

**Example Usage:**

```python

# Example Sudoku puzzle.

puzzle = [

['5', '3', '.', '.', '7', '8', '.', '.', '.'],

['.', '7', '4', '6', '.', '5', '8', '9', '.'],

['.', '.', '8', '.', '9', '1', '.', '6', '.'],

// ... Rest of the puzzle.

]

# Solve the Sudoku puzzle.

solution = solveSudoku(puzzle)

# Print the solved puzzle.

print(solution)

```

結(jié)論

SOTA 模型 Gemma 2 所展示的進(jìn)步在 AI 領(lǐng)域具有開(kāi)創(chuàng)性意義。Gemma 2 的配置利用了 90 億和 270 億個(gè)參數(shù),展示了性能、效率和關(guān)鍵安全性的提升。它可以與兩倍于其大小的模型相媲美,并且可以在單個(gè) NVIDIA Tensor Core GPU 或 TPU 主機(jī)上經(jīng)濟(jì)高效地運(yùn)行,使更廣泛的開(kāi)發(fā)人員和研究人員能夠使用高級(jí) AI。Gemma 2 的開(kāi)源性質(zhì)、廣泛的培訓(xùn)和技術(shù)增強(qiáng)凸顯了其卓越的性能,使其成為 AI 技術(shù)的關(guān)鍵發(fā)展。